Dizem que, para escrever bem, é preciso editar. Felizmente, para os leitores atentos de todo o mundo, a Microsoft disponibilizará um editor gramatical com tecnologia fornecida por AI para milhões de pessoas.

Como qualquer bom editor, ele é rápido e inteligente. Isso se deve ao fato de que o Editor da Microsoft no Microsoft Word on-line agora usa o Servidor de Inferência NVIDIA Triton, o ONNX Runtime e o Microsoft Azure Machine Learning, que é parte do Azure AI, para oferecer essa experiência inteligente.

No GTC – GPU Technology Conference, que aconteceu de 5 a 9 de outubro, o CEO da NVIDIA, Jensen Huang, anunciou as novidades durante sua apresentação.

Produtividade do Office com AI

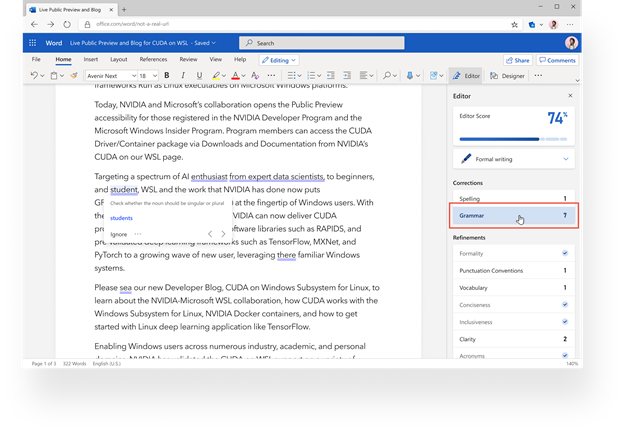

A Microsoft quer impressionar os usuários dos softwares de produtividade do Microsoft Office com a magia da AI. As novas experiências, além de pouparem tempo, sugerem correções gramaticais em tempo real, respondem a perguntas nos documentos, como a pesquisa do Bing para documentos, e prevê o restante do texto para ajudar o usuário a concluir as frases.

Essas experiências que aumentam a produtividade só são possíveis graças ao deep learning e às redes neurais. Por exemplo, diferente de serviços criados a partir de uma lógica tradicional baseada em regras, o Editor no Word para a web é capaz de entender o contexto de uma frase e sugerir as escolhas de palavras adequadas.

Além disso, os modelos de deep learning, que podem conter centenas de milhões de parâmetros, devem ser adaptáveis e oferecer inferências em tempo real para garantir a melhor experiência ao usuário. Estima-se que só o modelo de AI do Editor da Microsoft para verificação gramatical do Word na web, sozinho, já realize mais de 500 bilhões de consultas por ano.

Além disso, os modelos de deep learning, que podem conter centenas de milhões de parâmetros, devem ser adaptáveis e oferecer inferências em tempo real para garantir a melhor experiência ao usuário. Estima-se que só o modelo de AI do Editor da Microsoft para verificação gramatical do Word na web, sozinho, já realize mais de 500 bilhões de consultas por ano.

A implantação nessa escala pode exceder os orçamentos de deep learning. Felizmente, os recursos de execução de modelos simultâneos e lotes dinâmicos do NVIDIA Triton, acessíveis por meio do Azure Machine Learning, reduziram o custo em cerca de 70% e alcançaram uma taxa de rendimento de 450 consultas por segundo em uma única GPU NVIDIA V100 Tensor Core, com um tempo de resposta de menos de 200 milissegundos. O Azure Machine Learning garantiu a escala e os recursos necessários para gerenciar o ciclo de vida do modelo, como controle de versão e monitoramento.

Inferência de Alto Desempenho com o Triton no Azure Machine Learning

Com o aumento do tamanho dos modelos de machine learning, as GPUs se tornaram mais necessárias do que nunca no treinamento e na implementação do modelo. No caso da implementação de AI na produção, as empresas procuram recursos de inferência adaptáveis, suporte a vários back-ends de frameworks e uso excelente da GPU e da CPU, além do gerenciamento de ciclo de vida do machine learning.

O NVIDIA Triton com o pacote ONNX Runtime no Azure Machine Learning oferecem inferências adaptáveis de alto desempenho. Os usuários do Azure Machine Learning podem ter acesso ao suporte do Triton a vários frameworks, inferências de lotes e streaming em tempo real, processamento dinâmico e execução simultânea.

Escrevendo com AI no Word

Uma vez, o autor e poeta Robert Graves afirmou: “Não existe boa escrita, apenas boa reescrita”. Em outras palavras, escreva, edite e aprimore sua escrita.

Com o Editor do Word na web, você pode fazer as duas coisas ao mesmo tempo. Além disso, embora o Editor seja o primeiro recurso do Word a ter a velocidade e a amplitude dos avanços garantidos pelo Triton e pelo ONNX Runtime, é provável que outros recursos sejam disponibilizados no futuro.