Em breve, você poderá ver como futuras inundações podem atingir sua cidade com um modelo de AI recém-desenvolvido. O estudo, de uma equipe de pesquisadores canadenses e americanos, usa redes adversárias geradoras (GANs) para produzir imagens realistas de inundações induzidas pelas mudanças climáticas. Batizado de ClimateGAN, a equipe desenvolveu o modelo para enfatizar a destruição de eventos climáticos extremos e solicitar uma ação coletiva para reduzir as emissões.

“Projetar as consequências potenciais de eventos climáticos extremos, como inundações em lugares familiares, pode ajudar a tornar os impactos abstratos das mudanças climáticas mais concretos e incentivar a ação”, escreveram os pesquisadores.

Pessoas em todo o mundo estão lutando contra eventos climáticos extremos mais frequentes, incluindo tempestades, furacões, secas e incêndios florestais causados por um planeta em aquecimento. Comunidades litorâneas e do interior também estão enfrentando inundações mais intensas devido ao aumento do nível do mar, tempestades mais fortes e derretimento de neve mais rápido.

Os resultados devastadores do aquecimento global podem atingir as pessoas que passaram por essas catástrofes, sejam as inundações destruidoras do furacão Ida ou os incêndios devastadores em toda a Austrália. No entanto, muitos ainda veem os impactos das mudanças climáticas como uma ocorrência hipotética, distante ou incerta: um fenômeno psicológico denominado distanciamento.

De acordo com os pesquisadores, as perspectivas e imagens em primeira pessoa de eventos climáticos extremos podem reduzir o distanciamento. Até este ponto, a tecnologia digital, como visualizações geográficas e painéis de dados interativos, tem se concentrado na criação de renderizações regionais manuais, limitadas a locais específicos. Com o ClimateGAN, a equipe trabalhou para criar um framework de AI capaz de ilustrar enchentes em lugares familiares, para transformar os impactos abstratos das mudanças climáticas em exemplos concretos.

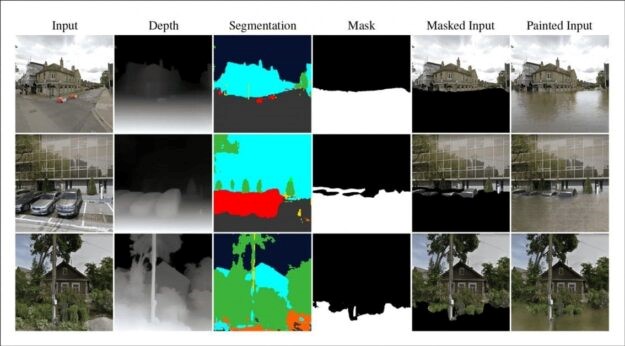

Usando um pipeline de tradução imagem a imagem não supervisionado de duas fases, o framework se baseia em imagens reais e dados simulados de um mundo virtual. Usando essas duas fontes de dados, o modelo Masker prevê a localização da água em uma imagem, se ocorrer uma inundação. Em seguida, o modelo Painter, que usa GauGAN, um modelo de deep learning desenvolvido pela Área de Pesquisa da NVIDIA, renderiza texturas de água contextualizadas guiadas pelo modelo Masker.

Amostrando uma ampla gama de regiões e cenários, 5540 imagens não inundadas foram usadas para treinar o modelo Masker e 1200 imagens inundadas para treinar o modelo Painter.

Juntos, o framework renderiza imagens realistas de enchentes em áreas urbanas, suburbanas e rurais.

Os pesquisadores afirmam que o objetivo de longo prazo deste trabalho é criar um sistema onde um usuário possa inserir qualquer endereço e ver uma versão da imagem afetada pelas mudanças climáticas do Google Street View.

O código e materiais adicionais estão disponíveis para download no GitHub.