Novos serviços em cloud para oferecer suporte a workflows de AI e o lançamento de uma nova geração de GPUs GeForce RTX foram mostrados hoje na apresentação do CEO da NVIDIA Jensen Huang no GTC, que contou com novos sistemas, silício e software.

“A computação está avançando a uma velocidade incrível, e o motor impulsionando esse foguete é a computação acelerada, seu combustível a AI”, disse Huang durante uma apresentação virtual ao iniciar o NVIDIA GTC.

Por várias vezes, Huang conectou novas tecnologias a novos produtos e a novas oportunidades, desde o aproveitamento da AI para encantar os gamers com gráficos inéditos até a construção de campos de prova virtuais onde as maiores empresas do mundo podem refinar seus produtos.

Impulsionando a onda de novas ideias, novos produtos e novas aplicações: uma visão única da computação acelerada desbloqueando avanços em AI, o que, por sua vez, impactará setores em todo o mundo.

Gamers e criadores receberão as primeiras GPUs baseadas na nova arquitetura NVIDIA Ada Lovelace.

As empresas terão novas ferramentas poderosas para aplicações de computação de alto desempenho com sistemas baseados na CPU Grace e no Superchip Grace Hopper. Aqueles construindo a internet 3D ganharão novos servidores OVX com a tecnologia das GPUs de data center Ada Lovelace L40. Pesquisadores e cientistas da computação obtêm novos recursos de grandes modelos de linguagem com o Serviço NVIDIA LLMs NeMo. E a indústria automobilística ganha Thor, um novo cérebro com surpreendentes 2.000 teraflops de desempenho.

Huang destacou como as tecnologias da NVIDIA estão sendo colocadas em prática por uma série de grandes parceiros e clientes em diversos setores.

Para acelerar a adoção, ele anunciou que a Deloitte, a maior empresa de serviços profissionais do mundo, está trazendo novos serviços construídos na AI da NVIDIA e no NVIDIA Omniverse para as empresas do mundo.

Além disso, ele compartilhou histórias de clientes da gigante de telecomunicações Charter, bem como da General Motors no setor automotivo, da Deutsche Bahn do sistema ferroviário alemão em transportes, do The Broad Institute em pesquisa médica e da Lowe’s no varejo.

O NVIDIA GTC, que iniciou esta semana, tornou-se um dos encontros de AI mais importantes do mundo, com mais de 200 palestrantes de empresas como Boeing, Deutsche Bank, Lowe’s, Polestar, Johnson & Johnson, Kroger, Mercedes-Benz, Siemens AG, T-Mobile e US Bank. Mais de 200.000 pessoas se inscreveram para a conferência.

Um “Salto Quântico”: GPUs GeForce RTX Série 40

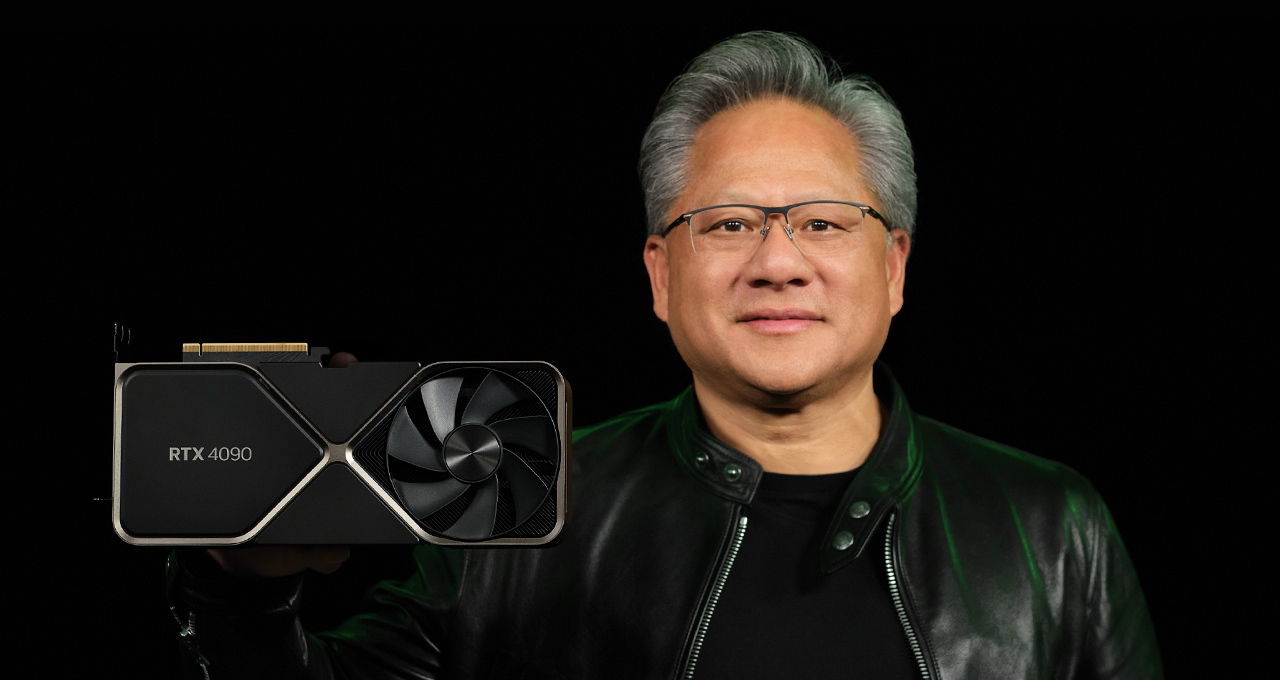

O primeiro bloco da apresentação concentrou-se no lançamento das GPUs GeForce RTX Série 40 de última geração com tecnologia Ada, o que Huang chamou de “salto quântico” que abre o caminho para criadores de mundos totalmente simulados.

O CEO da NVIDIA, Jensen Huang, lançou as GPUs GeForce RTX Série 40 de última geração.

Huang deu ao público uma ideia do que isso possibilita, oferecendo uma prévia do Racer RTX, uma simulação totalmente interativa de ray tracing, com toda a ação modelada fisicamente.

Os avanços da Ada incluem um novo Multiprocessador de Streaming, um novo RT Core com o dobro da taxa de processamento de interseção de ray-triangle e um novo Tensor Core com o Engine Transformer Hopper FP8 e 1,4 petaflops de potência do processador Tensor.

A Ada também apresenta a versão mais atual da tecnologia do NVIDIA DLSS, o DLSS 3, que usa a AI para gerar novos frames, comparando-os com frames anteriores para entender como uma cena está mudando. O resultado: aumento de até 4 vezes no desempenho no game em relação à renderização de força bruta.

O DLSS 3 recebeu suporte de muitos dos principais desenvolvedores de games do mundo, com mais de 35 games e aplicações anunciando suporte. “O DLSS 3 é uma das nossas maiores invenções de renderização neural”, disse Huang.

Juntas, Huang disse, essas inovações ajudam a oferecer uma taxa de processamento 4 vezes maior com a nova GeForce RTX 4090 em comparação com sua antecessora, a RTX 3090 Ti. “O novo campeão dos pesos pesados” parte de US$1.599 e estará disponível em 12 de outubro.

Além disso, a nova GeForce RTX 4080 será lançada em novembro com duas configurações.

A GeForce RTX 4080 de 16GB, com preço de US$1.199, tem 9.728 CUDA Cores e 16GB de memória Micron GDDR6X de alta velocidade. Com o DLSS 3, ela é duas vezes mais rápida nos games atuais do que a GeForce RTX 3080 Ti e mais potente do que a GeForce RTX 3090 Ti com potência mais baixa.

A GeForce RTX 4080 de 12GB tem 7.680 CUDA Cores e 12GB de memória Micron GDDR6X e, com o DLSS 3, é mais rápida do que a RTX 3090 Ti, a melhor GPU da geração anterior. Ela custa US$899.

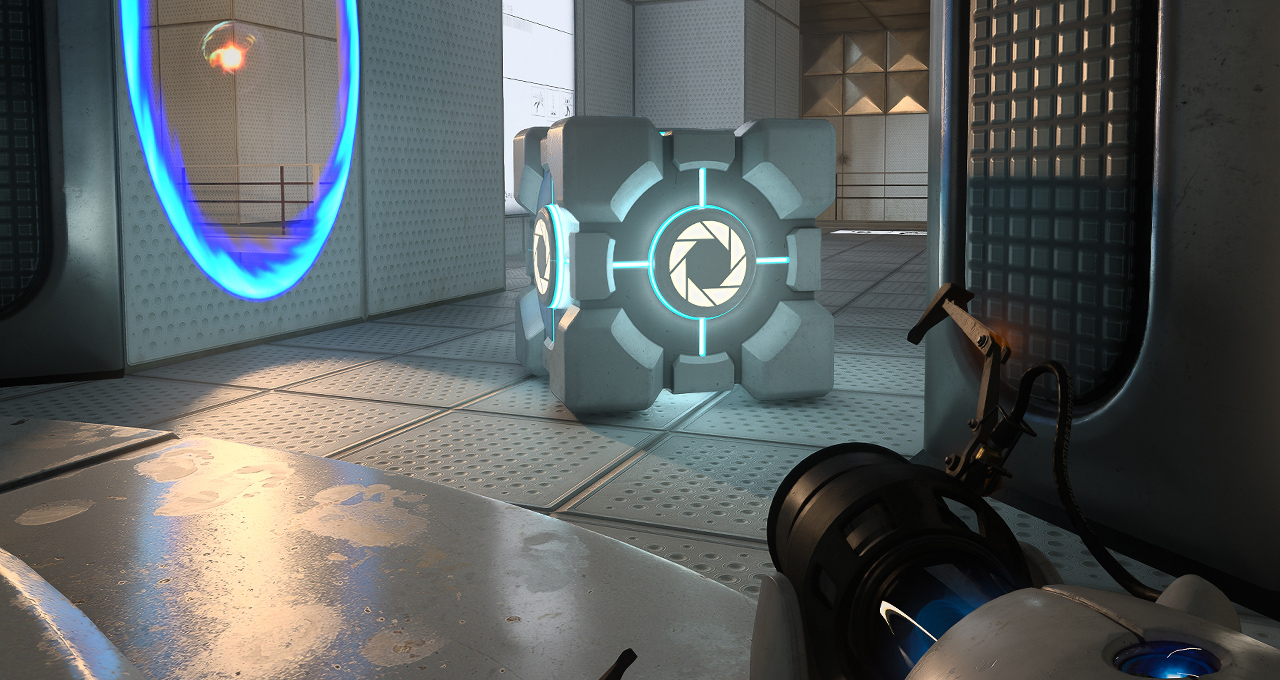

Huang também anunciou que o NVIDIA Lightspeed Studios usou o Omniverse para reimaginar Portal, um dos games mais celebrados da história. Com o NVIDIA RTX Remix, um conjunto de ferramentas assistido por AI, os usuários podem criar mods nos seus games favoritos, permitindo que eles aumentem as texturas e os elementos artísticos e ofereçam propriedades fisicamente precisas aos materiais.

Impulsionando Avanços de AI, GPU H100 em Produção Total

Depois de conectar sistemas e softwares a tendências tecnológicas mais amplas, Huang explicou que grandes modelos de linguagem (LLMs – Large Language Models) e sistemas de recomendação são os dois modelos de AI mais importantes atualmente.

Os sistemas de recomendação “mandam na economia digital”, impulsionando tudo, do e-commerce ao entretenimento e à publicidade, disse ele. “Eles são os engines por trás das mídias sociais, da publicidade digital, do e-commerce e das pesquisas.”

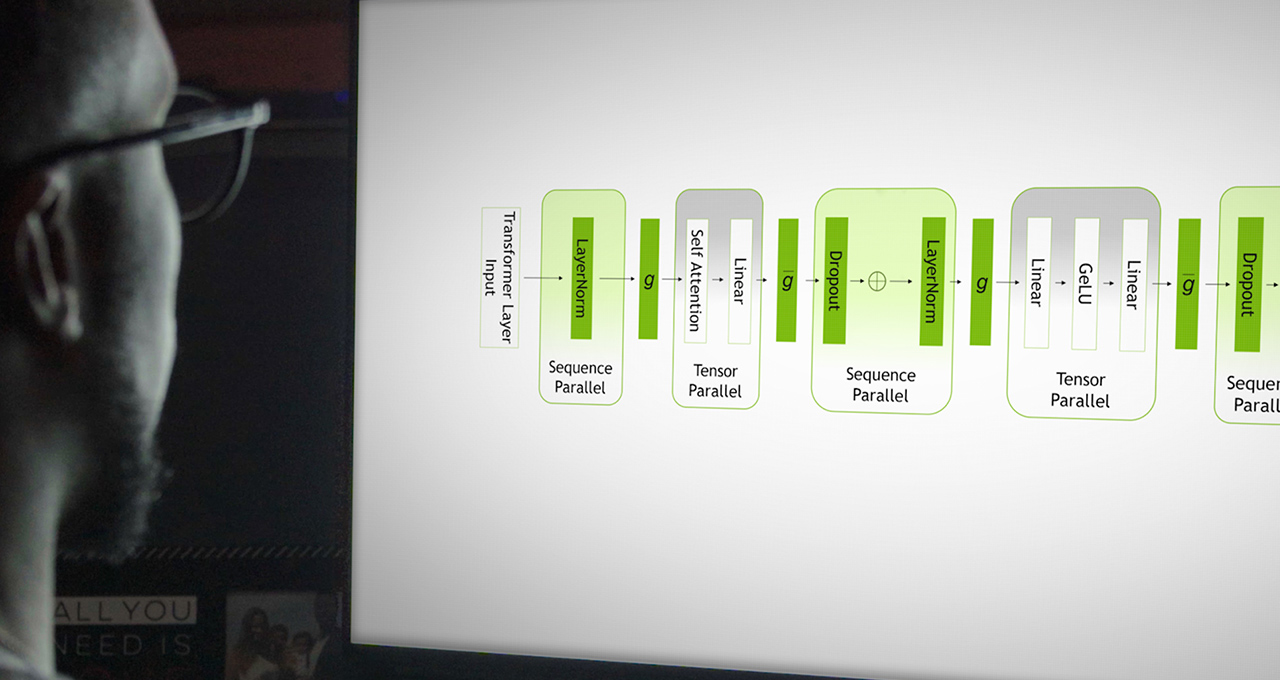

Além disso, os grandes modelos de linguagem baseados no modelo de deep learning Transformer introduzidos pela primeira vez em 2017 estão agora entre as áreas mais vibrantes para pesquisa em AI e capazes de aprender a entender a linguagem humana sem supervisão ou conjuntos de dados rotulados.

“Um único modelo pré-treinado pode executar várias tarefas, como resposta a perguntas, sumarização de documentos, geração de texto, tradução e até programação de software”, disse Huang.

Oferecendo a potência computacional necessária para potencializar esses modelos enormes, Huang disse que a GPU NVIDIA H100 Tensor Core, com o Transformer Engine de última geração Hopper, está em plena produção, com sistemas sendo enviados nas próximas semanas.

“Ela está em plena produção e, em breve, será lançada para impulsionar as fábricas de AI do mundo”, afirmou Huang.

Os parceiros que fabricam sistemas incluem Atos, Cisco, Dell Technologies, Fujitsu, GIGABYTE, Hewlett Packard Enterprise, Lenovo e Supermicro. Amazon Web Services, Google Cloud, Microsoft Azure e Oracle Cloud Infrastructure serão alguns dos primeiros a implementar instâncias baseadas em H100 no cloud a partir do próximo ano.

Grace Hopper, que combina a CPU do data center Grace baseado em Arm da NVIDIA, com as GPUs Hopper, com um aumento de 7 vezes na capacidade de memória rápida, proporcionará um “grande salto” para os sistemas de recomendação, afirmou Huang. Os sistemas que incorporam Grace Hopper estarão disponíveis no primeiro semestre de 2023.

Reunindo o Metaverso e as GPUs L40 de Data Center em Plena Produção

A próxima evolução da internet, chamada de metaverso, será ampliada com 3D, explicou Huang. O Omniverse é a plataforma da NVIDIA para a criação e execução de aplicações do metaverso.

Aqui, também, Huang explicou como conectar e simular esses mundos exigirá novos computadores poderosos e flexíveis. Além disso, os servidores NVIDIA OVX foram desenvolvidos para dimensionar aplicações do metaverso.

Os sistemas OVX de 2ª geração da NVIDIA contarão com a tecnologia das GPUs de data center Ada Lovelace L40, que agora estão em plena produção, anunciou Huang.

Thor para Veículos Autônomos, Robótica, Instrumentos Médicos e Muito Mais

Nos veículos de hoje, a segurança ativa, o estacionamento, o monitoramento do motorista, os espelhos das câmeras, o cluster e o entretenimento informativo são impulsionados por diferentes computadores. No futuro, eles serão entregues por um software que melhora com o tempo, sendo executado em um computador centralizado, afirmou Huang.

Para potencializar isso, Huang apresentou o DRIVE Thor, que combina o engine transformer da Hopper, a GPU da Ada e a incrível CPU da Grace.

O novo superchip Thor oferece 2.000 teraflops de desempenho, substituindo Atlan no roteiro do DRIVE e proporcionando uma transição perfeita do DRIVE Orin, que tem 254 TOPS de desempenho e está atualmente em veículos de produção. Thor será o processador de robótica, instrumentos médicos, automação industrial e sistemas de AI no edge, afirmou Huang.

3,5 Milhões de Desenvolvedores, 3.000 Aplicações Aceleradas

A disponibilização dos sistemas e do silício da NVIDIA, além das vantagens da computação acelerada para setores ao redor do mundo, é um ecossistema de softwares com mais de 3,5 milhões de desenvolvedores criando cerca de 3.000 aplicações aceleradas usando os 550 kits de desenvolvimento de softwares ou SDKs da NVIDIA e os modelos de AI, anunciou Huang.

E está crescendo rapidamente. Nos últimos 12 meses, a NVIDIA atualizou mais de 100 SDKs e introduziu 25 novos.

“Os novos SDKs aumentam a capacidade e o desempenho dos sistemas que nossos clientes já possuem e abrem novos mercados para computação acelerada”, disse Huang.

Novos Serviços para AI e Mundos Virtuais

Os grandes modelos de linguagem “são os modelos de AI mais importantes atualmente”, afirmou Huang. Com base na arquitetura transformer, esses modelos gigantes podem aprender a entender significados e linguagens sem supervisão ou conjuntos de dados rotulados, liberando novos recursos incríveis.

Para facilitar a aplicação dessa tecnologia “incrível” ao trabalho dos pesquisadores , Huang anunciou o Nemo LLM Service, um serviço em cloud gerenciado pela NVIDIA para adaptar LLMs pré-treinados para realizar tarefas específicas.

Para acelerar o trabalho de pesquisadores de medicamentos e biociências, Huang também anunciou o BioNeMo LLM, um serviço para criar LLMs que entendem sequências de substâncias químicas, proteínas, DNA e RNA.

Huang anunciou que está trabalhando com o The Broad Institute, o maior produtor mundial de informações genômicas humanas, para disponibilizar bibliotecas do NVIDIA Clara, como o NVIDIA Parabricks, o Genome Analysis Toolkit e o BioNeMo, na Plataforma Terra Cloud do Broad.

Huang também detalhou o NVIDIA Omniverse Cloud, uma infraestrutura como serviço que conecta aplicações do Omniverse em execução no cloud, on premise ou em um dispositivo.

Novos contêineres do Omniverse, Replicator para geração de dados sintéticos, Farm para dimensionamento de render farms e Isaac Sim para construção e treinamento de robôs de AI, agora estão disponíveis para implantação em cloud, anunciou Huang.

O Omniverse está vendo uma ampla adoção, e Huang compartilhou várias histórias e demonstrações de clientes:

- A Lowe’s, que tem quase 2.000 pontos de venda, está usando o Omniverse para projetar, construir e operar digital twins de suas lojas;

- Charter, um provedor de telecomunicações de US$50 bilhões e um provedor interativo de análise de dados HeavyAI, estão usando o Omniverse para criar digital twins das redes 4G e 5G da Charter;

- A GM está criando um digital twin de seu Michigan Design Studio no Omniverse, no qual designers, engenheiros e profissionais de marketing podem colaborar.

A varejista de reformas residenciais Lowe’s está usando o Omniverse para projetar, construir e operar digital twins de suas lojas.

Novo Jetson Orin Nano para Robótica

Passando de mundos virtuais para máquinas que se moverão pelo mundo, os computadores robóticos “são os mais novos tipos de computadores”, disse Huang, descrevendo o processador de segunda geração da NVIDIA para robótica, o Orin, como uma vitória.

Para levar o Orin a mais mercados, ele anunciou o Jetson Orin Nano, um pequeno computador de robótica que é 80 vezes mais rápido do que o superpopular Jetson Nano anterior.

O Jetson Orin Nano executa o pacote de robótica NVIDIA Isaac e conta com o framework acelerado por GPU ROS 2, e o NVIDIA Iaaac Sim, uma plataforma de simulação de robótica, está disponível no cloud.

Para desenvolvedores de robótica que usam o AWS RoboMaker, Huang anunciou que os contêineres da plataforma NVIDIA Isaac para o desenvolvimento de robótica estão no mercado da AWS.

Novas Ferramentas para Serviços de Vídeo e Imagens

A maior parte do tráfego de internet do mundo é de vídeo, e as transmissões de vídeo geradas pelo usuário serão cada vez mais aumentadas por efeitos especiais de AI e computação gráfica, explicou Huang.

“Os avatares farão visão computacional, AI de fala, compreensão de linguagem e computação gráfica em tempo real e em escala de cloud”, disse Huang.

Para possibilitar inovações na interseção de gráficos em tempo real, AI e comunicações, Huang anunciou que a NVIDIA vem desenvolvendo bibliotecas de aceleração como CV-CUDA, um engine de tempo de execução em cloud chamado UCF Unified Computing Framework, Omniverse ACE Avatar Cloud Engine e uma aplicação de amostra chamada Tokkio para avatares de atendimento ao cliente.

Deloitte Trará AI e Serviços do Omniverse para Empresas

Para acelerar a adoção de todas essas tecnologias para as empresas do mundo, a Deloitte, a maior empresa de serviços profissionais do mundo, está trazendo novos serviços construídos na AI da NVIDIA e no NVIDIA Omniverse para as empresas do mundo.

Ele disse que os profissionais da Deloitte ajudarão as empresas do mundo a usar os frameworks de aplicações da NVIDIA para criar modernas aplicações multi-cloud para atendimento ao cliente, cibersegurança, automação industrial, automação de depósitos e varejo e muito mais.

Apenas Começando

Huang encerrou sua apresentação recapitulando uma palestra que passou da apresentação de novas tecnologias para anúncios de produtos e de volta, unindo dezenas de partes diferentes em uma visão única.

“Hoje, anunciamos novos chips, novos avanços para nossas plataformas e, pela primeira vez, novos serviços em cloud”, disse Huang ao encerrar. “Essas plataformas impulsionam novos avanços em AI, novas aplicações de AI e a próxima onda de AI para a ciência e a indústria.”