O ano de 2021 viu um crescimento maciço na demanda por computação no edge, impulsionada pela pandemia, a necessidade de processos de negócios mais eficientes, bem como os principais avanços na Internet das Coisas, 5G e AI.

Em um estudo publicado pela IBM em maio de 2021, por exemplo, 94% dos executivos pesquisados disseram que suas empresas implementarão a computação no edge nos próximos cinco anos.

De hospitais e cidades inteligentes a lojas sem caixa e veículos autônomos, a AI no edge, a combinação de computação no edge e AI, é necessária mais do que nunca.

As empresas foram atingidas por problemas logísticos, escassez de trabalhadores, inflação e incertezas causadas pela pandemia em curso. As soluções de AI no edge podem ser usadas como uma ponte entre humanos e máquinas, permitindo previsões aprimoradas, alocação de trabalhadores, design de produtos e logística.

Aqui estão as cinco principais tendências de AI no edge que a NVIDIA espera ver em 2022:

1. O Gerenciamento no Edge se Torna um Foco do IT

Embora a computação no edge esteja rapidamente se tornando obrigatória para muitas empresas, as implantações permanecem nos estágios iniciais.

Para passar para a produção, o gerenciamento de AI no edge se tornará responsabilidade dos departamentos de IT. Em um relatório recente, a Gartner escreveu: “As soluções no edge têm sido historicamente gerenciadas pela linha de negócios, mas a responsabilidade está mudando para a IT, e as organizações estão utilizando recursos de IT para otimizar custos.”1

Para enfrentar os desafios da computação no edge relacionados à capacidade de gerenciamento, segurança e escala, os departamentos de IT se voltarão para a tecnologia nativa no cloud. O Kubernetes, uma plataforma para microsserviços em contêiner, surgiu como a principal ferramenta para gerenciar aplicações de AI no edge em grande escala.

Os clientes com departamentos de IT que já usam o Kubernetes no cloud podem transferir sua experiência para criar suas próprias soluções de gerenciamento nativas no cloud ao edge. Mais empresas procurarão comprar ofertas de terceiros, como Red Hat OpenShift, VMware Tanzu, Wind River Cloud Platform e NVIDIA Fleet Command.

2. Expansão dos Casos de Uso de AI no Edge

A visão computacional dominou as implantações de AI no edge. O reconhecimento de imagem liderou o treinamento de AI, resultando em um ecossistema robusto de aplicações de visão computacional.

O NVIDIA Metropolis, um framework de aplicações e um conjunto de ferramentas para desenvolvedores que ajudam a criar aplicações de AI de visão computacional, aumentou sua rede de parceiros 100 vezes desde 2017 para agora incluir mais de 1.000 membros.

Muitas empresas estão implantando ou comprando aplicações de visão computacional. Essas empresas na vanguarda da visão computacional começarão a procurar soluções multimodais.

A AI multimodal traz diferentes fontes de dados para criar aplicações mais inteligentes que podem responder ao que veem, ouvem e sentem. Esses casos de uso de AI complexos empregam habilidades como compreensão de linguagem natural, AI conversacional, estimativa de pose, inspeção e visualização.

Combinado com armazenamento de dados, tecnologias de processamento e recursos de entrada/saída ou sensor, a AI multimodal pode gerar desempenho em tempo real no edge para uma expansão de casos de uso em robótica, área da saúde, publicidade hiperpersonalizada, compras sem caixa, experiências de concierge e muito mais.

Imagine fazer compras com um assistente virtual. Com a AI tradicional, um avatar pode ver o que você pega em uma prateleira e um assistente de fala pode ouvir o que você pede.

Ao combinar as duas fontes de dados, um avatar multimodal baseado em AI pode ouvir seu pedido, fornecer uma resposta, ver sua reação e fornecer outras respostas com base nele. Essas informações complementares permitem que a AI ofereça uma experiência melhor e mais interativa ao cliente.

Para ver um exemplo disso em ação, confira o Projeto Tokkio:

3. Convergência de Soluções de AI e IoT industrial

A fábrica inteligente é outro espaço impulsionado por novas aplicações de AI no edge. De acordo com o mesmo relatório do Gartner, “até 2027, o machine learning na forma de deep learning será incluído em mais de 65% dos casos de uso no edge, contra menos de 10% em 2021”.

As fábricas podem adicionar aplicações de AI em câmeras e outros sensores para inspeção e manutenção preditiva. No entanto, a detecção é apenas o primeiro passo. Uma vez que um problema é detectado, uma ação deve ser tomada.

As aplicações de AI são capazes de detectar uma anomalia ou defeito e, em seguida, alertar um humano para intervir. Mas para aplicações de segurança e outros casos de uso em que é necessária uma ação instantânea, as respostas em tempo real são possíveis conectando a aplicação de inferência de AI às plataformas de IoT que gerenciam as linhas de montagem, braços robóticos ou máquinas pick-and-place.

A integração entre essas aplicações depende do trabalho de desenvolvimento personalizado. Portanto, espere mais parcerias entre AI e plataformas tradicionais de gerenciamento de IoT que simplifiquem a adoção de AI no edge em ambientes industriais.

4. Crescimento na Adoção Corporativa de AI-on-5G

A infraestrutura de computação combinada AI-on-5G fornece uma malha de conectividade segura e de alto desempenho para integrar sensores, plataformas de computação e aplicações de AI, seja em campo, no local ou no edge.

As principais vantagens incluem latência ultrabaixa em ambientes sem fio, qualidade de serviço garantida e segurança aprimorada.

AI-on-5G desbloqueará novos casos de uso de AI no edge:

- Indústria 4.0: Automação de plantas, robôs de fábrica, monitoramento e inspeção.

- Sistemas automotivos: aplicações de telemetria em rodovias e veículos.

- Espaços inteligentes: aplicações de varejo, cidade inteligente e cadeia de suprimentos.

Uma das primeiras plataformas full stack AI-on-5G do mundo, Mavenir Edge AI, foi lançada em novembro de 2021. Neste ano, esperamos ver soluções full-stack adicionais que forneçam desempenho, gerenciamento e escala de ambientes 5G corporativos.

5. Gerenciamento do Ciclo de Vida da AI do Cloud ao Edge

Para organizações que implantam AI no edge, os MLOps se tornarão a chave para ajudar a impulsionar o fluxo de dados de e para o edge. A ingestão de dados ou insights novos e interessantes no edge, retreinar modelos, testar aplicações e reimplantá-los no edge melhora a precisão e os resultados do modelo.

Com o software tradicional, as atualizações podem ocorrer trimestralmente ou anualmente, mas a AI ganha significativamente com um ciclo contínuo de atualizações.

O MLOps ainda está em desenvolvimento inicial, com muitos grandes players e startups criando soluções para a necessidade constante de atualizações de tecnologia de AI. Embora, por enquanto, se concentre principalmente na solução do problema do data center, essas soluções no futuro mudarão para a computação no edge.

Aproveitando a Próxima Onda da Computação de AI

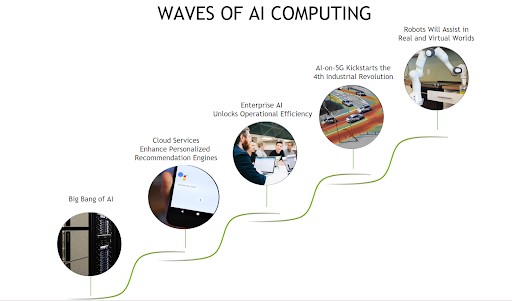

O desenvolvimento da AI consistiu em várias ondas, como ilustrado acima.

A democratização da AI está em andamento, com novas ferramentas e soluções tornando-a realidade. A AI no edge, impulsionada pelo enorme crescimento em IoT e disponibilidade de 5G, é a próxima onda a quebrar.

Em 2022, mais empresas levarão sua inferência de AI para o edge, reforçando o crescimento do ecossistema à medida que o setor analisa como se estender do cloud ao edge.

Saiba mais sobre AI no edge assistindo à sessão on demand do GTC, The Rise of Intelligent Edge: From Enterprise to Device Edge.

Confira as soluções de computação no edge da NVIDIA.

1 Gartner, “Predicts 2022: The Distributed Enterprise Drives Computing to the Edge”, 20 de outubro de 2021. Pelos analistas: Thomas Bittman, Bob Gill, Tim Zimmerman, Ted Friedman, Neil MacDonald, Karen Brown