Em uma apresentação especial, rápida e impressionante na SIGGRAPH, os executivos da NVIDIA descreveram as forças que impulsionam a próxima era dos gráficos e a crescente gama de ferramentas da empresa para acelerá-las.

“A combinação de AI e computação gráfica impulsionará o metaverso, a próxima evolução da internet”, disse Jensen Huang, fundador e CEO da NVIDIA, dando início à palestra de 45 minutos.

Ele será o lar de mundos virtuais conectados e digital twins, um local para trabalhar e também para se divertir. Segundo Huang, ele será vibrante com o que se tornará uma das formas mais populares de robôs: avatares humanos digitais.

Com 45 demonstrações e slides, cinco palestrantes da NVIDIA anunciaram o seguinte:

- Uma nova plataforma para criar avatares, o NVIDIA Omniverse Avatar Cloud Engine (ACE).

- Planos para criar a Universal Scene Description (USD), a linguagem do metaverso.

- Importantes extensões do NVIDIA Omniverse, a plataforma de computação para criação de mundos virtuais e digital twins.

- Ferramentas para turbinar os workflows gráficos com machine learning.

“Os anúncios que fizemos hoje avançam ainda mais o metaverso, uma nova plataforma de computação com novos modelos de programação, novas arquiteturas e novos padrões”, disse ele.

As aplicações do metaverso já estão aqui.

Huang apontou para “produtos 3D virtuais que você pode experimentar com realidade aumentada, empresas de telecomunicações criando digital twins de suas redes de rádio para otimizar e implantar torres de rádio [e] empresas criando digital twins de depósitos e fábricas para otimizar seu layout e logística”.

Chegam Os Avatares

O metaverso ganhará vida com assistentes virtuais, avatares com os quais interagimos tão naturalmente quanto conversar com outra pessoa. Eles trabalharão em fábricas digitais, jogarão em games on-line e prestarão atendimento ao cliente para varejistas de comércio eletrônico.

“Haverá bilhões de avatares”, afirmou Huang, chamando-os de “um dos tipos mais usados de robôs” que serão projetados, treinados e operados no Omniverse.

Humanos e avatares digitais exigem processamento de linguagem natural, visão computacional, animações faciais e corporais complexas e muito mais. Para se mover e falar de maneira realista, esse conjunto de tecnologias complexas precisa ser sincronizado ao milissegundo.

É um trabalho árduo que a NVIDIA pretende simplificar e acelerar com o Omniverse Avatar Cloud Engine. O ACE é um conjunto de modelos e serviços de AI que se baseiam no trabalho da NVIDIA, abrangendo desde AI conversacional até ferramentas de animação como Audio2Face e Audio2Emotion.

MetaHuman no Unreal Engine imagem de cortesia da Epic Games

“Com o Omniverse ACE, os desenvolvedores podem criar, configurar e implementar sua aplicação de avatar em qualquer engine em qualquer cloud público ou privado”, disse Simon Yuen, diretor de gráficos e AI da NVIDIA. “Queremos democratizar a criação de avatares interativos para todas as plataformas.”

O ACE estará disponível no início do próximo ano e será executado em sistemas integrados e em todos os principais serviços em cloud.

Yuen também demonstrou a versão mais atual do Omniverse Audio2Face, um modelo de AI que pode criar animações faciais diretamente a partir de vozes.

“Acabamos de acrescentar mais recursos para analisar e transferir automaticamente suas emoções para seu avatar”, disse ele.

As futuras versões do Audio2Face criarão avatares a partir de uma única foto, aplicando texturas automaticamente e gerando malhas 3D prontas para animação. Elas terão simulações de alta fidelidade de movimentos musculares que uma AI pode aprender ao assistir a um vídeo, até mesmo cabelos realistas que respondem conforme esperado a uma escovação virtual.

USD, uma Base para a Internet 3D

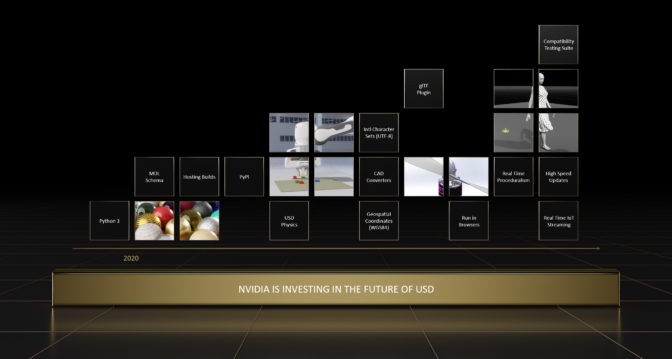

Muitos superpoderes do metaverso serão fundamentados no USD, uma base para a Internet 3D.

O metaverso “precisa de uma maneira padrão de descrever todas as coisas dentro dos mundos 3D”, disse Rev Lebaredian, vice-presidente de tecnologia de simulação e do Omniverse da NVIDIA.

“Acreditamos que a Universal Scene Description, criada e de código aberto desenvolvido pela Pixar, é a descrição padrão da cena da próxima era da internet”, acrescentou, comparando o USD com o HTML na web 2D.

Lebaredian descreveu a visão da NVIDIA para o USD como uma chave para abrir ainda mais oportunidades do que as do mundo físico.

“Nossos próximos marcos visam melhorar o desempenho do USD para mundos virtuais em tempo real e de grande escala e digital twins industriais”, disse ele, observando os planos da NVIDIA de ajudar a construir suporte no USD para conjuntos de personagens internacionais, coordenadas geoespaciais e streaming em tempo real de dados de IoT.

Para acelerar ainda mais a adoção do USD, a NVIDIA lançará um pacote de testes de compatibilidade e certificação para USD. Ele permite que os desenvolvedores saibam que seus componentes de USD personalizados produzem um resultado esperado.

Além disso, a NVIDIA anunciou um conjunto de elementos artísticos de USD prontos para simulação, projetados para uso em digital twins industriais e workflows de treinamento de AI. Eles se juntam a uma série de recursos do USD disponíveis on-line gratuitamente, incluindo cenas prontas para USD, tutoriais on demand, documentação e cursos ministrados por instrutores.

“Queremos que todos ajudem a construir e desenvolver o USD”, disse Lebaredian.

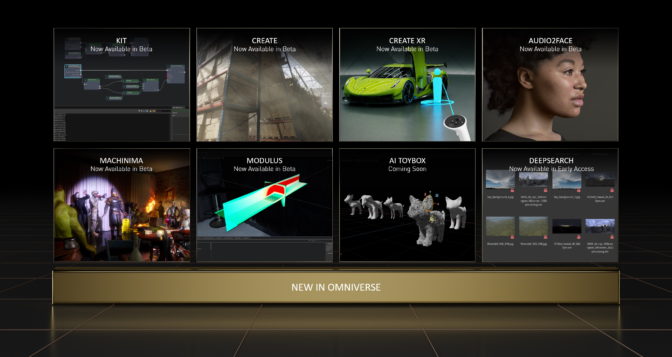

O Omniverse Amplia Sua Paleta

Um dos maiores anúncios da apresentação especial foi uma nova e importante versão do NVIDIA Omniverse, uma plataforma que já foi baixada 184.000 vezes.

Huang chamou o Omniverse de “uma plataforma de USD, um kit de ferramentas para a criação de aplicações de metaverso e um engine de computação para executar mundos virtuais”.

A última versão oferece várias tecnologias fundamentais atualizadas e mais conexões com ferramentas populares.

Os links, chamados Conectores do Omniverse, estão agora em desenvolvimento para Unity, Blender, Autodesk Alias, Siemens JT, SimScale, Open Geospatial Consortium e muito mais. Os Conectores já estão disponíveis em Beta para o PTC Creo, Visual Components e SideFX Houdini. Esses novos desenvolvimentos se juntam ao Siemens Xcelerator, que agora faz parte da rede do Omniverse, recebendo mais clientes industriais na era dos digital twins.

Assim como a própria internet, o Omniverse é “uma rede de redes”, conectando usuários de todos os setores e áreas, afirmou Steve Parker, vice-presidente de gráficos profissionais da NVIDIA.

Quase uma dúzia de parceiros mostrarão os recursos do Omniverse na SIGGRAPH, incluindo fornecedores de hardware, software e serviços no cloud, desde a AWS e a Adobe até a Dell, a Epic e a Microsoft. Meia dúzia de parceiros conduzirão sessões com tecnologia fornecida pela NVIDIA sobre tópicos como AI e mundos virtuais.

Acelerando a Física, Animando Animais

Parker detalhou vários upgrades tecnológicos no Omniverse. Eles abrangem melhorias para simular materiais fisicamente precisos com a Linguagem de Definição de Material (MDL – Material Definition Language), física em tempo real com o PhysX e o sistema de renderização híbrida e AI, RTX.

“Esses principais pilares tecnológicos são impulsionados pela computação de alto desempenho da NVIDIA, do edge ao cloud”, disse Parker.

O PhysX, por exemplo, agora é compatível com a simulação de tecidos de partículas e de corpo macio, proporcionando mais precisão física aos mundos virtuais em tempo real. Além disso, a NVIDIA está disponibilizando o código aberto completo do MDL para que possa fornecer suporte imediato a padrões de API gráfica, como OpenGL ou Vulkan, tornando o padrão de materiais mais amplamente disponível para os desenvolvedores.

O Omniverse também incluirá recursos gráficos neurais desenvolvidos pela Pesquisa na NVIDIA que combinam gráficos RTX e AI. Por exemplo:

- Os Modeladores de Animais permitem que os artistas iterem na forma de um animal com clouds de pontos e, em seguida, gerem automaticamente uma malha 3D.

- O GauGAN360, a próxima evolução do NVIDIA GauGAN, gera panoramas de 8K e 360 graus que podem ser facilmente carregados em uma cena do Omniverse.

- O Instant NeRF cria objetos e cenas 3D a partir de imagens 2D.

Uma Extensão do Omniverse para NVIDIA Modulus, um framework de machine learning, permitirá que os desenvolvedores usem AI para acelerar simulações de física do mundo real em até 100.000 vezes, de modo que o metaverso tenha a aparência do mundo físico.

Além disso, o Omniverse Machinima, objeto de um concurso animado na SIGGRAPH, agora conta com conteúdo de Post Scriptum, Beyond the Wire e Shadow Warrior 3, bem como novas ferramentas de animação de AI, como o Audio2Gesture.

Uma demonstração da Industrial Light & Magic mostrou outro novo recurso. O Omniverse DeepSearch usa AI para ajudar as equipes a pesquisar intuitivamente bancos de dados enormes de elementos artísticos não registrados, trazendo resultados precisos para termos mesmo quando não estão listados especificamente em metadados.

Os Gráficos Ficam Mais Inteligentes

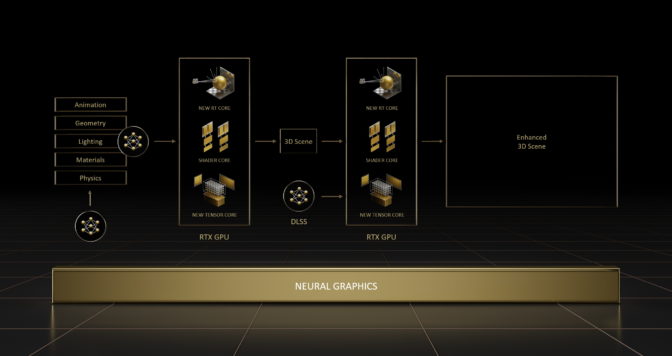

Um dos pilares essenciais do metaverso emergente são os gráficos neurais. É uma disciplina híbrida que aproveita modelos de redes neurais para acelerar e aprimorar a computação gráfica.

“Os gráficos neurais entrelaçam a AI e os gráficos, abrindo o caminho para um futuro pipeline gráfico que é favorável ao aprendizado a partir de dados”, disse Sanja Fidler, vice-presidente de AI da NVIDIA. “Os gráficos neurais redefinirão como os mundos virtuais são criados, simulados e vivenciados pelos usuários”, ela acrescentou.

A AI ajudará os artistas a gerar a enorme quantidade de conteúdo 3D necessária para criar o metaverso. Por exemplo, eles podem usar gráficos neurais para capturar rapidamente objetos e comportamentos no mundo físico.

Fidler descreveu o software da NVIDIA para fazer exatamente isso, o Instant NeRF, uma ferramenta para criar um objeto ou uma cena 3D a partir de imagens 2D. Esse é o assunto de um dos dois prêmios de melhor artigo da NVIDIA na SIGGRAPH.

Na outra premiação de melhor artigo, os gráficos neurais alimentam um modelo que pode prever e reduzir as latências de reação em aplicações de Esports e AR/VR. Os dois melhores artigos estão entre os 16 que os pesquisadores da NVIDIA apresentarão esta semana na SIGGRAPH.

Designers e pesquisadores podem aplicar gráficos neurais e outras técnicas para criar seus próprios trabalhos dignos de serem premiados usando os novos kits de desenvolvimento de software que a NVIDIA apresentou no evento.

Fidler descreveu um deles, o Kaolin Wisp, um conjunto de ferramentas para criar campos neurais, modelos de AI que representam uma cena ou um objeto 3D, com apenas algumas linhas de código.

Separadamente, a NVIDIA anunciou o NeuralVDB, a próxima evolução do OpenVDB, padrão de código aberto que os setores, desde efeitos visuais à computação científica, usam para simular e renderizar água, fogo, fumaça e nuvens.

O NeuralVDB usa modelos neurais e otimização de GPU para reduzir significativamente os requisitos de memória para que os usuários possam interagir com conjuntos de dados extremamente grandes e complexos em tempo real e compartilhá-los com mais eficiência.

“A AI, a força tecnológica mais poderosa da atualidade, revolucionará todos os campos da ciência da computação, incluindo a computação gráfica, e a NVIDIA RTX é o engine dos gráficos neurais”, disse Huang.

Assista à apresentação especial da NVIDIA na íntegra no site do evento da SIGGRAPH, que também inclui detalhes de laboratórios, apresentações e a estreia de um filme documental.