Todo mundo quer computação verde.

Os usuários móveis exigem o máximo desempenho e duração da bateria. Empresas e governos exigem cada vez mais sistemas poderosos, mas ecologicamente corretos. E os serviços em nuvem devem responder às demandas globais sem fazer a rede gaguejar.

Por essas e outras razões, a computação verde evoluiu rapidamente nas últimas três décadas e veio para ficar.

O Que É Computação Verde?

A computação verde, ou computação sustentável, é a prática de maximizar a eficiência energética e minimizar o impacto ambiental nas formas como chips, sistemas e softwares de computador são projetados e usados.

Também chamada de tecnologia da informação verde, IT verde ou IT sustentável, a computação verde abrange preocupações em toda a cadeia de suprimentos, desde as matérias-primas usadas para fazer computadores até como os sistemas são reciclados.

Em suas vidas profissionais, os computadores verdes devem fornecer o máximo de trabalho pela menor quantidade de energia, normalmente medida pelo desempenho por watt.

Por Que a Computação Verde É Importante?

A computação verde é uma ferramenta significativa para combater as mudanças climáticas, a ameaça existencial do nosso tempo.

As temperaturas globais aumentaram cerca de 1,2°C no último século. Como resultado, as calotas polares estão derretendo, fazendo com que o nível do mar suba cerca de 20 centímetros e aumentando o número e a severidade de eventos climáticos extremos.

O uso crescente de eletricidade é uma das causas do aquecimento global. Os data centers representam uma pequena fração do uso total de eletricidade, cerca de 1% ou 200 terawatts-hora por ano, mas são um fator crescente que exige atenção.

Computadores potentes e energeticamente eficientes são parte da solução. Eles estão avançando a ciência e nossa qualidade de vida, incluindo as maneiras como entendemos e respondemos às mudanças climáticas.

Quais São os Elementos da Computação Verde?

Os engenheiros sabem que a computação verde é uma disciplina holística.

“A eficiência energética é um problema de pilha completa, desde o software até os chips”, disse Sachin Idgunji, copresidente do grupo de trabalho de energia para o benchmark de IA MLPerf da indústria e um engenheiro distinto que trabalha em análise de desempenho na NVIDIA.

Por exemplo, em uma análise, ele descobriu que os sistemas NVIDIA DGX A100 proporcionaram uma melhoria de quase 5 vezes na eficiência energética em benchmarks de treinamento de IA em expansão em comparação com a geração anterior.

“Minha função principal é analisar e melhorar a eficiência energética de aplicações de IA em tudo, desde a GPU e o nó do sistema até a escala completa do data center”, disse ele.

O trabalho de Idgunji é uma descrição de trabalho para um quadro crescente de engenheiros construindo produtos de smartphones a supercomputadores.

Qual É a História da Computação Verde?

A computação verde ganhou os holofotes públicos em 1992, quando a Agência de Proteção Ambiental dos EUA lançou o Energy Star, um programa para identificar eletrônicos de consumo que atendiam aos padrões de eficiência energética.

Um relatório de 2017 encontrou quase 100 programas governamentais e industriais em 22 países promovendo o que chamou de TICs verdes, tecnologias sustentáveis de informação e comunicação.

Uma dessas organizações, o Green Electronics Council, fornece a Ferramenta de Avaliação Ambiental de Produtos Eletrônicos, um registro de sistemas e seus níveis de eficiência energética. O conselho afirma que economizou quase 400 milhões de megawatts-hora de eletricidade por meio do uso de 1,5 bilhão de produtos verdes recomendados até o momento.

O trabalho em computação verde continua em toda a indústria em todos os níveis.

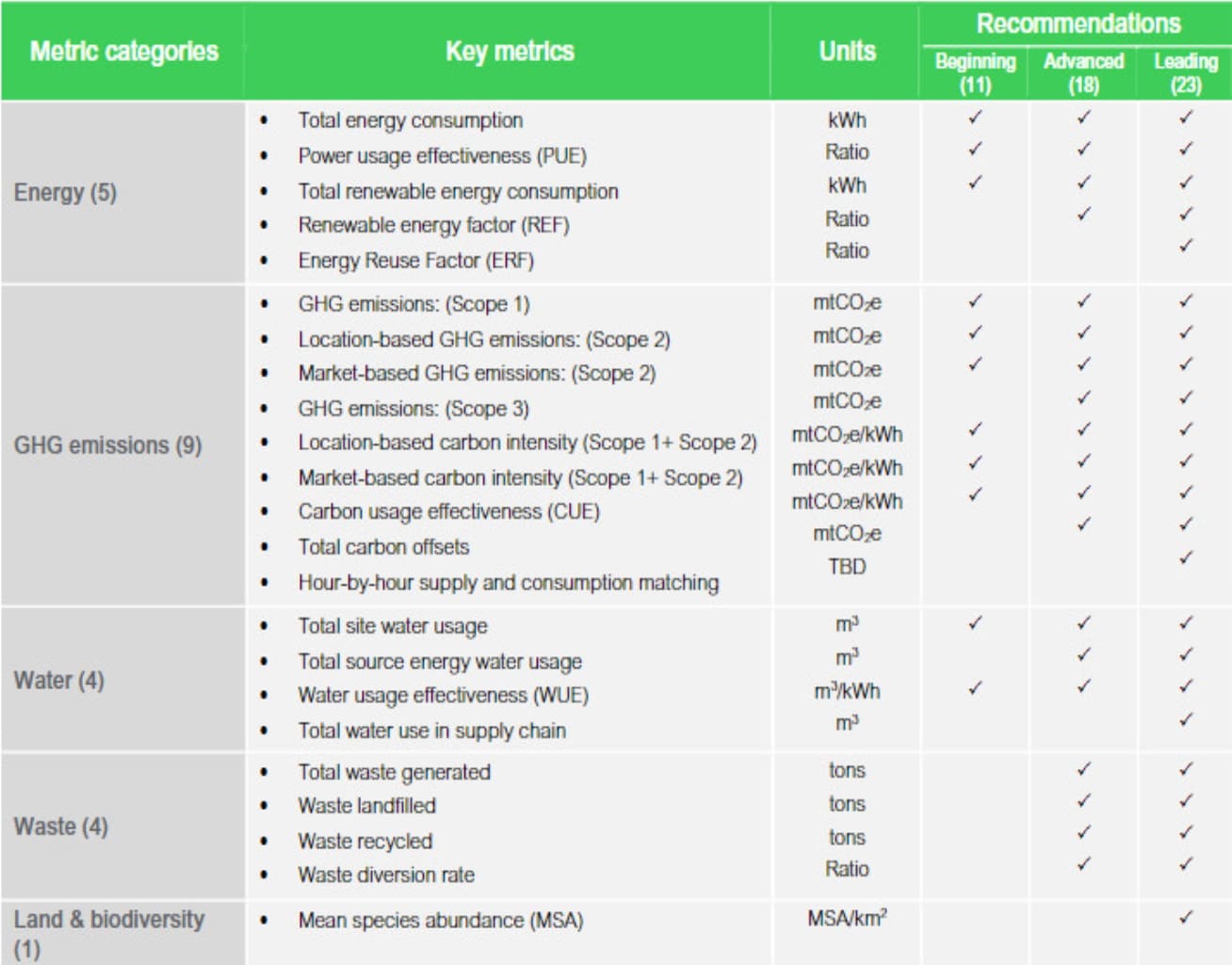

Por exemplo, alguns grandes data centers usam resfriamento líquido, enquanto outros localizam data centers onde podem usar ar ambiente frio. A Schneider Electric lançou recentemente um documento técnico recomendando 23 métricas para determinar o nível de sustentabilidade dos data centers.

Pioneira em Eficiência Energética

Wu Feng, professor de ciência da computação na Virginia Tech, construiu uma carreira ultrapassando os limites da computação verde. Tudo começou por necessidade, enquanto ele trabalhava no Laboratório Nacional de Los Alamos.

Um cluster de computadores para pesquisa de ciência aberta que ele mantinha em um armazém externo tinha o dobro de falhas nos verões do que nos invernos. Então, ele construiu um sistema de baixa potência que não geraria tanto calor.

Ele fez uma demonstração do sistema, apelidado de Green Destiny, na conferência Supercomputing em 2001. Coberto pela BBC, CNN e New York Times, entre outros, provocou anos de conversas e debates na comunidade de HPC sobre a confiabilidade potencial, bem como a eficiência da computação verde.

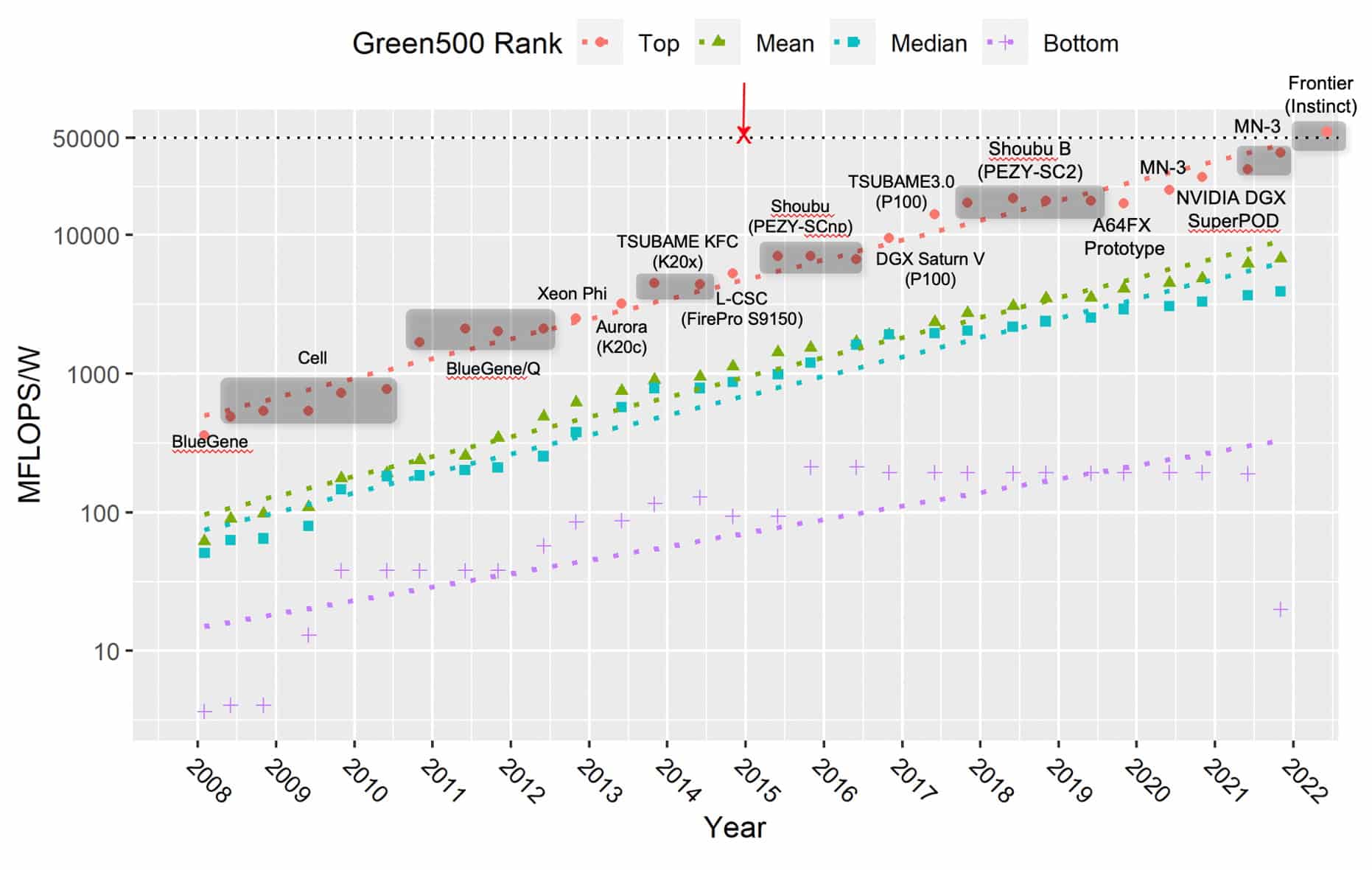

O interesse aumentou à medida que supercomputadores e data centers cresceram, ultrapassando seus limites no consumo de energia. Em novembro de 2007, depois de trabalhar com cerca de 30 luminárias de HPC e coletar feedback da comunidade, Feng lançou a primeira Lista Green500, a referência da indústria para supercomputação com eficiência energética.

Uma Referência de Computação Verde

O Green500 se tornou um ponto de encontro para uma comunidade que precisava reinar no consumo de energia enquanto levava o desempenho a novos patamares.

“A eficiência energética aumentou exponencialmente, os flops por watt dobraram a cada ano e meio para o supercomputador mais verde no topo da lista”, disse Feng.

Por algumas medidas, os resultados mostraram que a eficiência energética dos sistemas mais verdes do mundo aumentou duas ordens de magnitude nos últimos 14 anos.

Feng atribui os ganhos principalmente ao uso de aceleradores como GPUs, hoje comuns entre os sistemas mais rápidos do mundo.

“Os aceleradores adicionaram a capacidade de executar código de forma massivamente paralela, sem muita sobrecarga: eles nos permitem correr incrivelmente rápido”, disse ele.

Ele citou duas gerações dos supercomputadores Tsubame no Japão como primeiros exemplos. Eles usaram GPUs de arquitetura NVIDIA Kepler e Pascal para liderar a lista Green500 em 2014 e 2017, parte de uma procissão de sistemas acelerados por GPU na lista.

“Os aceleradores tiveram um enorme impacto em toda a lista”, disse Feng, que receberá um prêmio por seu trabalho de supercomputação verde no evento Supercomputing em novembro.

“Notavelmente, a NVIDIA foi fantástica em seu engajamento e apoio ao Green500, garantindo que seus números de eficiência energética fossem relatados, ajudando assim a eficiência energética a se tornar um cidadão de primeira classe em como os supercomputadores são projetados hoje”, acrescentou.

IA e Rede Ficam Mais Eficientes

Hoje, GPUs e unidades de processamento de dados (DPUs) estão trazendo maior eficiência energética para tarefas de IA e rede, bem como trabalhos de HPC, como simulações executadas em supercomputadores e data centers corporativos.

A IA, a tecnologia mais poderosa do nosso tempo, se tornará parte de todos os negócios. A McKinsey estima que a IA adicionará impressionantes US$ 13 trilhões ao PIB global até 2030, à medida que as implantações crescem.

A NVIDIA estima que os data centers poderiam economizar 19 terawatts-hora de eletricidade por ano se todos os descarregamentos de IA, HPC e rede fossem executados em aceleradores de GPU e DPU (veja os gráficos abaixo). Isso equivale ao consumo de energia de 2,9 milhões de carros de passeio dirigidos por um ano.

É uma medida impressionante do potencial de eficiência energética com computação acelerada.

Benchmark de IA Mede Eficiência

Como a IA representa uma parte crescente das cargas de trabalho corporativas, os benchmarks do setor MLPerf para IA têm medido o desempenho por watt em envios para data center e inferência no edge desde fevereiro de 2021.

“A próxima fronteira para nós é medir a eficiência energética para IA em sistemas distribuídos maiores, para cargas de trabalho de HPC e para treinamento de IA; é semelhante ao trabalho do Green500”, disse Idgunji, cujo grupo de energia na MLPerf inclui membros de seis outras empresas de chips e sistemas.

Os resultados públicos motivam os participantes a fazer melhorias significativas a cada geração de produto. Eles também ajudam engenheiros e desenvolvedores a entender maneiras de equilibrar desempenho e eficiência nas principais cargas de trabalho de IA que o MLPerf testa.

“As otimizações de software são uma grande parte do trabalho porque podem levar a grandes impactos na eficiência energética e, se o seu sistema é eficiente em termos de energia, também é mais confiável”, disse Idgunji.

Computação Verde para Consumidores

Em PCs e laptops, “estamos investindo em eficiência há muito tempo porque é a coisa certa a fazer”, disse Narayan Kulshrestha, arquiteto de energia de GPU da NVIDIA que trabalha no campo há quase duas décadas.

Por exemplo, o Dynamic Boost 2.0 usa aprendizado profundo para direcionar automaticamente a energia para uma CPU, uma GPU ou a memória de uma GPU para aumentar a eficiência do sistema. Além disso, a NVIDIA criou um design de nível de sistema para laptops, chamado Max-Q, para otimizar e equilibrar a eficiência energética e o desempenho.

Construindo uma Economia Cíclica

Quando um usuário substitui um sistema, a prática padrão na computação verde é que o sistema antigo é quebrado e reciclado. Mas Matt Hull vê melhores possibilidades.

“Nossa visão é uma economia cíclica que permite que todos tenham IA em uma variedade de preços”, disse Hull, vice-presidente de vendas de produtos de IA de data center da NVIDIA.

Assim, ele pretende encontrar no sistema uma nova casa com usuários em países em desenvolvimento que o considerem útil e acessível. É um trabalho em andamento buscando o parceiro certo e escrevendo um novo capítulo em um processo de gerenciamento de ciclo de vida existente.

Computação Verde Combate Mudanças Climáticas

Os computadores energeticamente eficientes estão entre as ferramentas mais afiadas no combate às alterações climáticas.

Cientistas em laboratórios governamentais e universidades há muito usam GPUs para modelar cenários climáticos e prever padrões climáticos. Avanços recentes em IA, impulsionados por GPUs NVIDIA, agora podem ajudar a modelar a previsão do tempo 100.000 vezes mais rápido do que os modelos tradicionais. Assista ao vídeo a seguir para obter detalhes:

Em um esforço para acelerar a ciência climática, a NVIDIA anunciou planos para construir o Earth-2, um supercomputador de IA dedicado a prever os impactos das mudanças climáticas. Ele usará o NVIDIA Omniverse, uma plataforma de colaboração e simulação de design 3D, para construir um gêmeo digital da Terra para que os cientistas possam modelar climas em resolução ultra-alta.

Além disso, a NVIDIA está trabalhando com o Centro de Satélites das Nações Unidas para acelerar a gestão de desastres climáticos e treinar cientistas de dados em todo o mundo no uso de IA para melhorar a detecção de inundações.

Enquanto isso, as concessionárias estão adotando o machine learning para avançar em direção a uma rede verde, resiliente e inteligente. As usinas de energia estão usando gêmeos digitais para prever manutenção dispendiosa e modelar novas fontes de energia, como projetos de reatores de fusão.

O Que Vem Pela Frente na Computação Verde?

Feng vê a tecnologia central por trás da computação verde avançando em várias frentes.

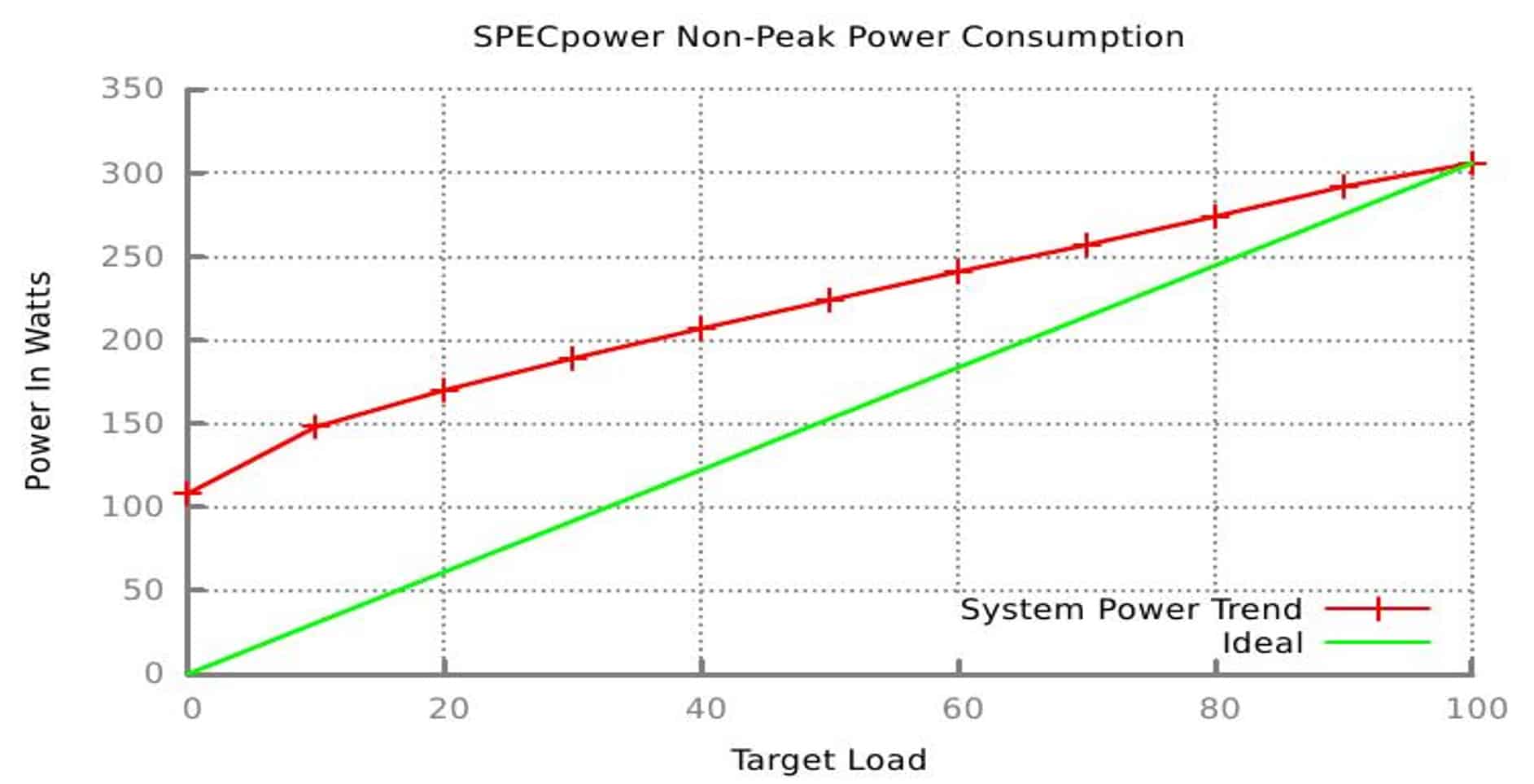

No curto prazo, ele está trabalhando no que é chamado de proporcionalidade de energia, ou seja, maneiras de garantir que os sistemas obtenham potência máxima quando precisarem de desempenho máximo e escalem graciosamente para potência zero à medida que diminuem a velocidade para uma marcha lenta, como um motor de carro moderno que desacelera seus RPMs e depois desliga em um sinal vermelho.

A longo prazo, ele está explorando maneiras de minimizar a movimentação de dados dentro e entre chips de computador para reduzir seu consumo de energia. E ele está entre muitos pesquisadores que estudam a promessa da computação quântica de oferecer novos tipos de aceleração.

Tudo isso faz parte do trabalho contínuo da computação verde, oferecendo cada vez mais desempenho com eficiência cada vez maior.