O ano de 2025 foi decisivo para o desenvolvimento de IA em PCs.

Os modelos de linguagem de pequeno porte (SLMs) para PC melhoraram sua precisão em quase 2 vezes em relação a 2024, reduzindo drasticamente a diferença para os modelos de linguagem de grande porte (LLMs) de última geração baseados em nuvem. As ferramentas de desenvolvimento de IA para PC, incluindo Ollama, ComfyUI, llama.cpp e Unsloth, amadureceram e a sua popularidade dobrou ano a ano, assim como o número de usuários que baixaram modelos para PC cresceu dez vezes desde 2024.

Esses avanços estão abrindo caminho para que a IA generativa seja amplamente adotada por criadores de conteúdo em PCs, jogadores e usuários de aplicativos de produtividade ainda este ano.

Na CES desta semana, a NVIDIA anunciou uma série de atualizações de IA para as placas GeForce RTX, NVIDIA RTX PRO e NVIDIA DGX Spark, que liberam o desempenho e a memória necessários para que os desenvolvedores implementem IA generativa em PCs, incluindo:

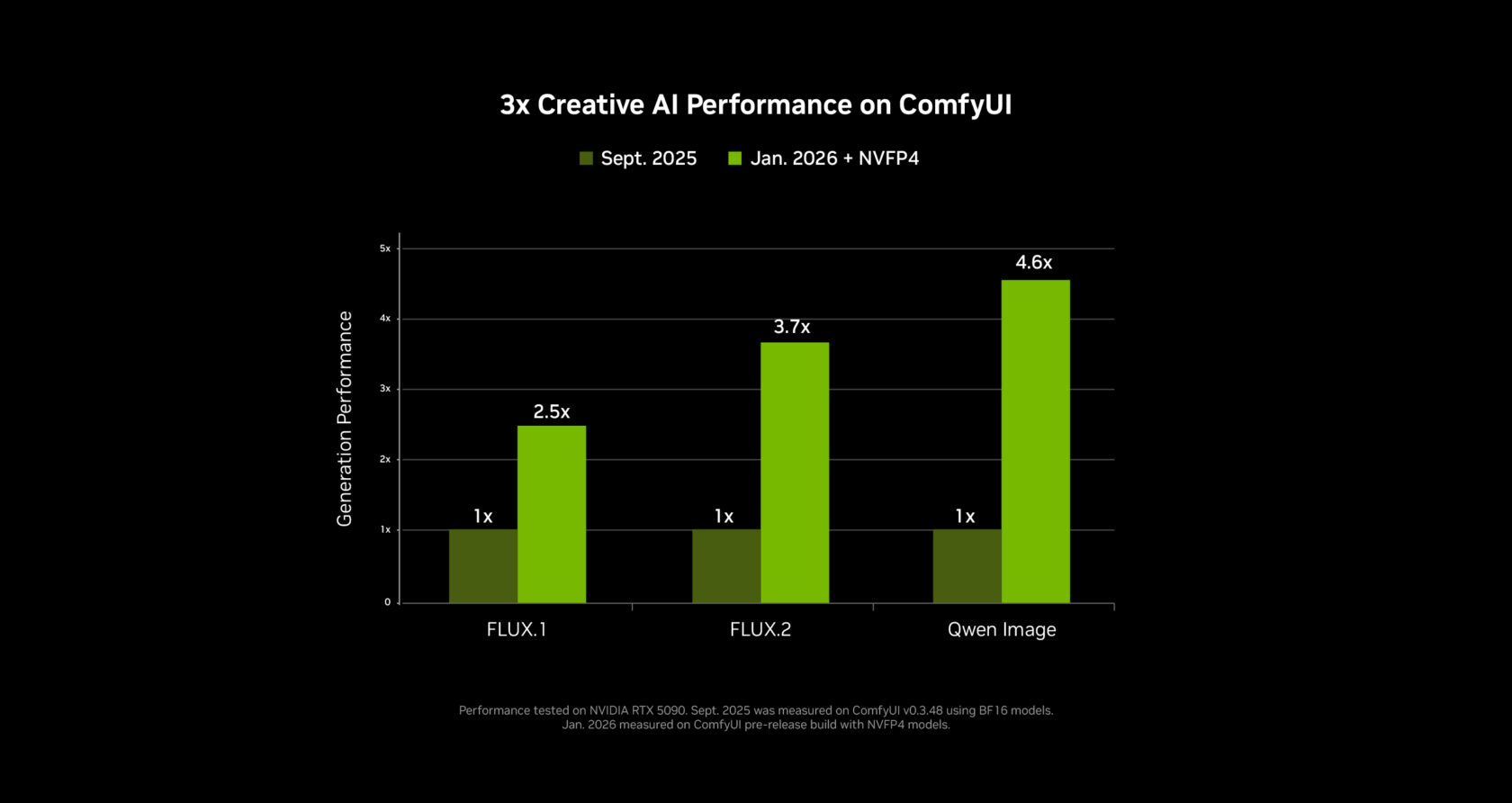

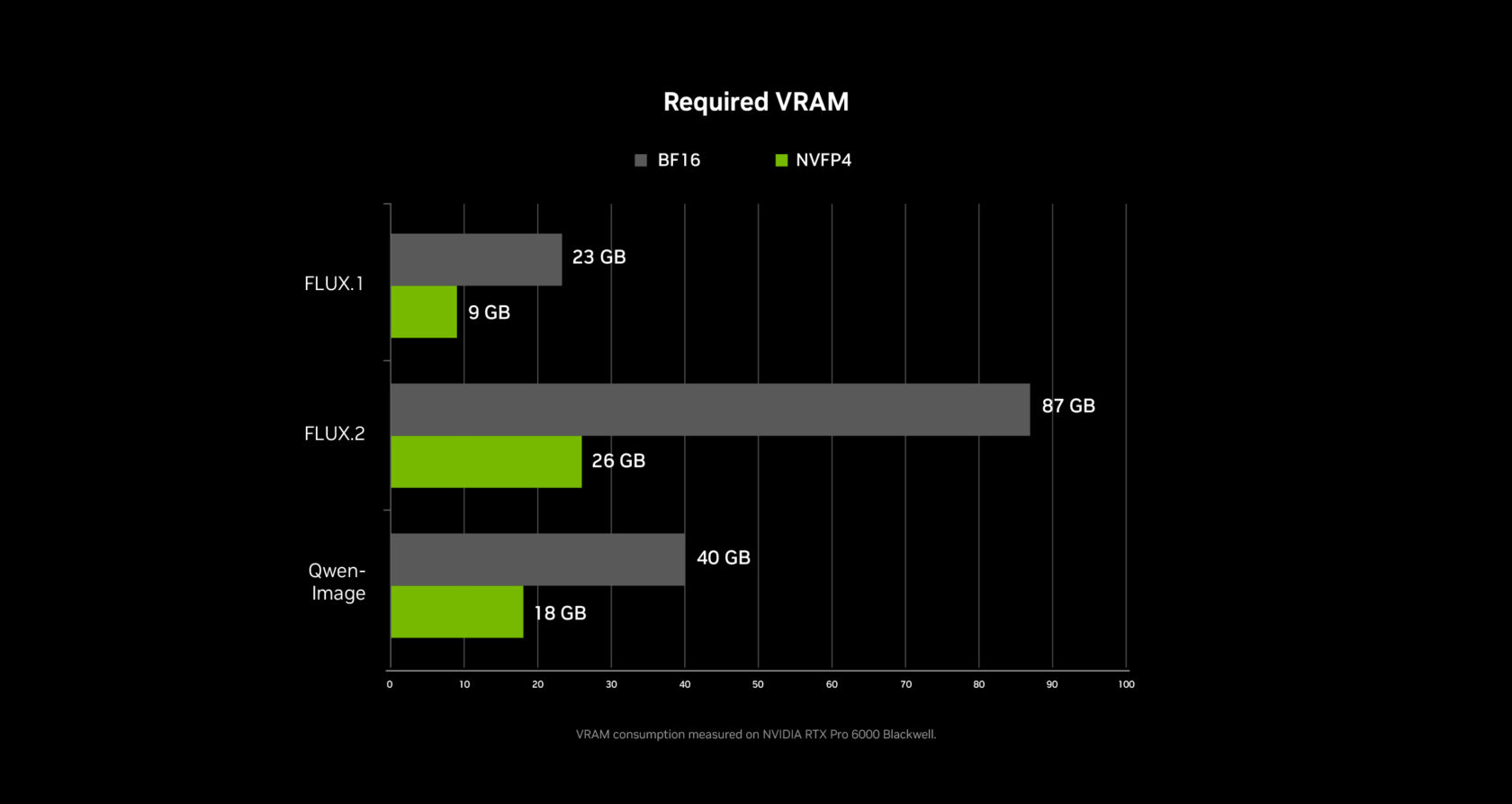

- Desempenho até 3 vezes maior e redução de 60% na VRAM para IA generativa de vídeo e imagem por meio de otimizações PyTorch-CUDA e suporte nativo à precisão NVFP4/FP8 no ComfyUI.

- Integração do RTX Video Super Resolution no ComfyUI, acelerando a geração de vídeo 4K.

- Otimizações NVIDIA NVFP8 para a versão de pesos abertos do modelo de geração de áudio e vídeo LTX-2 de última geração da Lightricks.

- Um novo pipeline de geração de vídeo para gerar vídeo 4K com IA usando uma cena 3D no Blender para controlar com precisão as saídas.

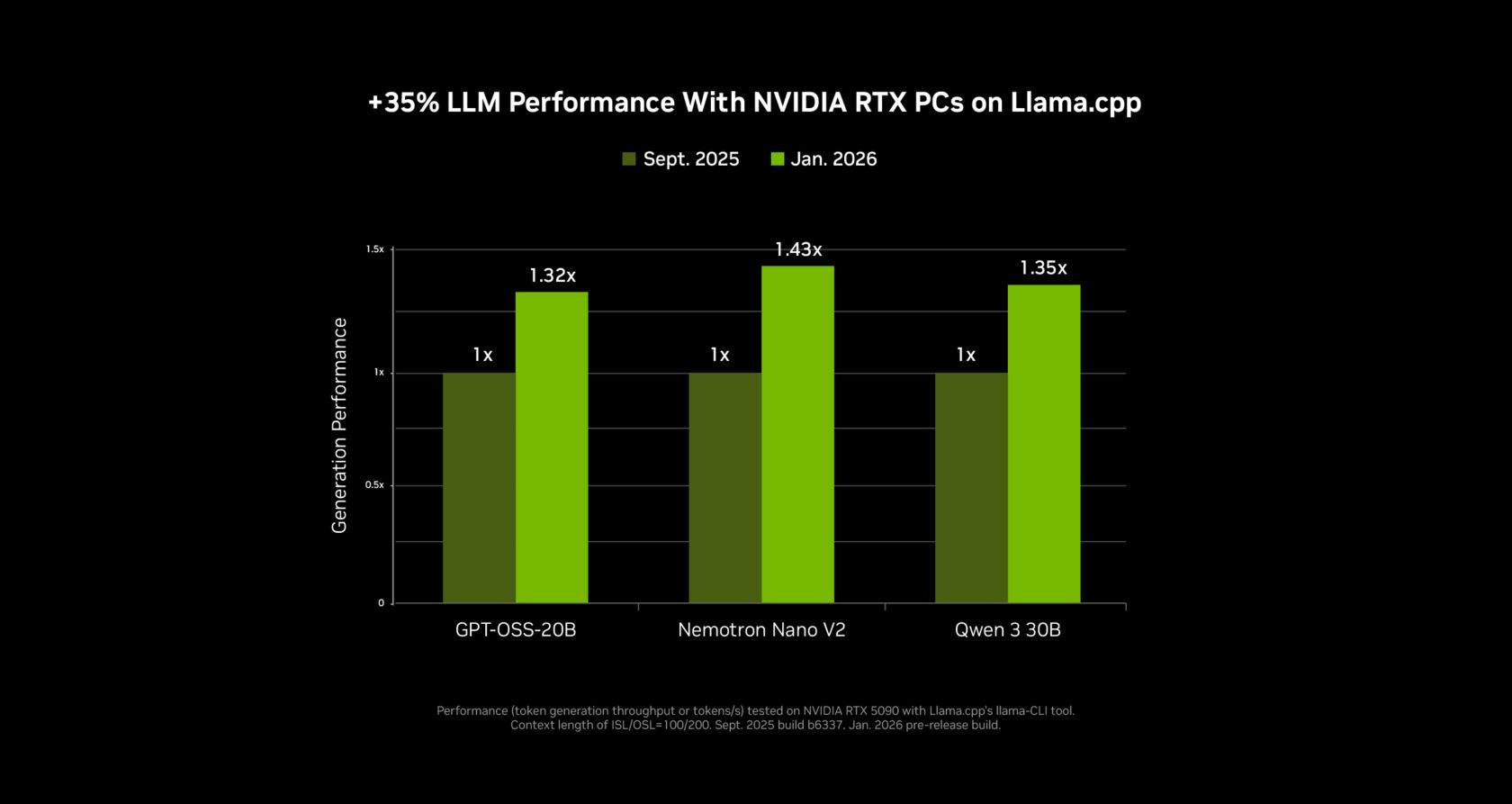

- Desempenho de inferência até 35% mais rápido para SLMs via Ollama e llama.cpp.

- Aceleração RTX para o novo recurso de busca de vídeos Hyperlink da Nexa.ai.

Esses avanços permitirão que os usuários executem fluxos de trabalho avançados de IA para vídeo, imagem e linguagem de forma integrada, com a privacidade, segurança e baixa latência oferecidas pelos PCs RTX com IA locais.

Gere vídeos 3 vezes mais rápido e em 4K em PCs com RTX.

A IA generativa pode criar vídeos incríveis, mas as ferramentas online podem ser difíceis de controlar apenas com comandos. E tentar gerar vídeos em 4K é quase impossível, já que a maioria dos modelos é grande demais para caber na VRAM do PC.

Hoje, a NVIDIA apresenta um pipeline de geração de vídeo com tecnologia RTX que permite aos artistas obter controle preciso sobre suas gerações, gerando vídeos 3 vezes mais rápido e ampliando-os para 4K — usando apenas uma fração da VRAM.

Este fluxo de trabalho de vídeo permite que artistas emergentes criem um storyboard, o transformem em keyframes fotorrealistas e, em seguida, transformem esses keyframes em um vídeo 4K de alta qualidade. O fluxo de trabalho é dividido em três modelos que os artistas podem combinar ou modificar de acordo com suas necessidades:

- Um gerador de objetos 3D que cria elementos para cenas.

- Um gerador de imagens guiado em 3D que permite aos usuários configurar sua cena no Blender e gerar keyframes fotorrealistas a partir dela.

- Um gerador de vídeo que segue os keyframes de início e fim definidos pelo usuário para animar o vídeo e utiliza a tecnologia NVIDIA RTX Video para aumentar a resolução para 4K.

Este fluxo de trabalho é possível graças ao lançamento inovador do novo modelo LTX-2 da Lightricks, disponível para download hoje mesmo.

Um marco importante para a criação local de vídeos com IA, o LTX-2 oferece resultados que rivalizam com os principais modelos baseados em nuvem, gerando até 20 segundos de vídeo 4K com fidelidade visual impressionante. O modelo conta com áudio integrado, suporte a múltiplos keyframes e recursos avançados de condicionamento, aprimorados com adaptações de baixo nível controláveis, proporcionando aos criadores qualidade e controle cinematográficos sem depender de serviços em nuvem.

Nos bastidores, o pipeline é alimentado pelo ComfyUI. Nos últimos meses, a NVIDIA trabalhou em estreita colaboração com o ComfyUI para otimizar o desempenho em 40% nas GPUs NVIDIA, e a atualização mais recente adiciona suporte aos formatos de dados NVFP4 e NVFP8. Combinando tudo isso, o desempenho é 3 vezes mais rápido e a VRAM é reduzida em 60% com o formato NVFP4 da série RTX 50, e o desempenho é 2 vezes mais rápido e a VRAM é reduzida em 40% com o NVFP8.

Os checkpoints NVFP4 e NVFP8 já estão disponíveis para alguns dos principais modelos diretamente no ComfyUI. Esses modelos incluem o LTX-2 da Lightricks, o FLUX.1 e o FLUX.2 da Black Forest Labs, e o Qwen-Image e o Z-Image da Alibaba. Faça o download diretamente no ComfyUI; suporte para outros modelos estará disponível em breve.

Após a geração de um videoclipe, os vídeos são ampliados para 4K em segundos usando o novo RTX Video node no ComfyUI. Este recurso de ampliação funciona em tempo real, aprimora as bordas e elimina artefatos de compressão para uma imagem final nítida. O RTX Video estará disponível no ComfyUI no próximo mês.

Para ajudar os usuários a ultrapassarem os limites da memória da GPU, a NVIDIA colaborou com a ComfyUI para aprimorar seu recurso de descarregamento de memória, conhecido como streaming de pesos. Com o streaming de pesos ativado, a ComfyUI pode usar a RAM do sistema quando a VRAM se esgota, permitindo modelos maiores e grafos de nós multiestágios mais complexos em GPUs RTX de gama média.

O fluxo de trabalho de geração de vídeo estará disponível para download no próximo mês, com as novas versões de código aberto do modelo de vídeo LTX-2 e as atualizações do ComfyUI RTX já disponíveis.

Uma nova maneira de pesquisar arquivos e vídeos no PC

A busca de arquivos em PCs permanece praticamente a mesma há décadas. Ela ainda depende principalmente de nomes de arquivos e metadados incompletos, o que torna a localização daquele documento do ano passado muito mais difícil do que deveria ser.

O Hyperlink (agente de busca local da Nexa.ai) transforma os PCs com RTX em uma base de conhecimento pesquisável que pode responder a perguntas em linguagem natural com citações embutidas. Ele consegue escanear e indexar documentos, slides, PDFs e imagens, permitindo que as buscas sejam guiadas por ideias e conteúdo, em vez de tentativas e erros com base no nome do arquivo. Todos os dados são processados localmente e permanecem no PC do usuário, garantindo privacidade e segurança. Além disso, o Hyperlink é acelerado por RTX, levando 30 segundos por gigabyte para indexar arquivos de texto e imagem e três segundos para obter uma resposta em uma GPU RTX 5090, em comparação com uma hora por gigabyte para indexar arquivos e 90 segundos para obter uma resposta em CPUs.

Na CES, a Nexa.ai está apresentando uma nova versão beta do Hyperlink que adiciona suporte para conteúdo de vídeo, permitindo que os usuários pesquisem objetos, ações e falas em seus vídeos. Isso é ideal para usuários que vão desde artistas de vídeo em busca de imagens de apoio até jogadores que querem encontrar aquela partida de battle royale em que ganharam para compartilhar com os amigos.

Para quem tiver interesse em experimentar a versão beta privada do Hyperlink, inscreva-se para obter acesso nesta página. O acesso será liberado a partir deste mês.

Small Language Models (Modelos de linguagem pequenos) ficam 35% mais rápidos

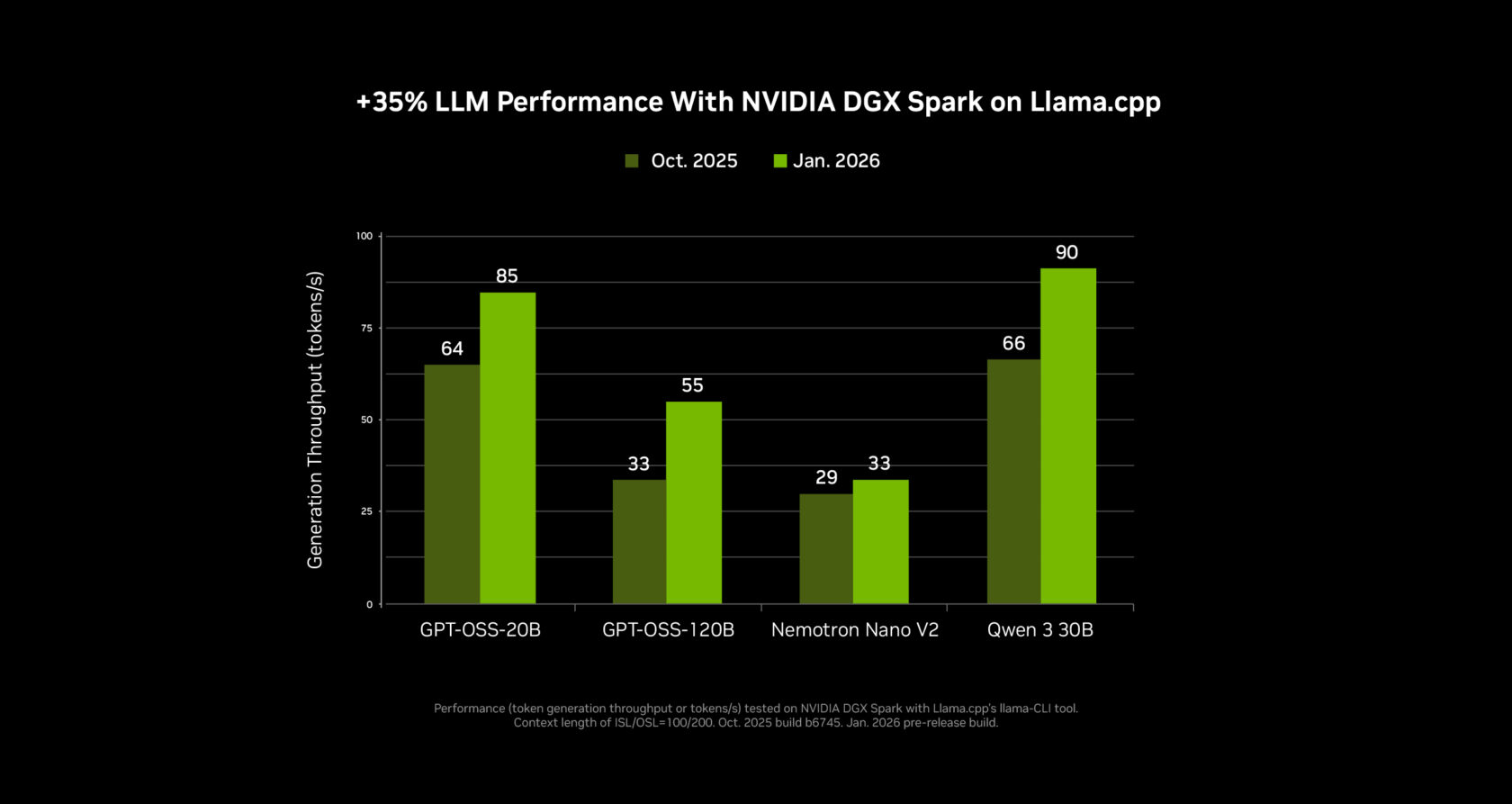

A NVIDIA colaborou com a comunidade de código aberto para oferecer ganhos de desempenho significativos para SLMs em GPUs RTX e no supercomputador desktop NVIDIA DGX Spark, utilizando Llama.cpp e Ollama. As mudanças mais recentes são especialmente benéficas para modelos de mistura de especialistas, incluindo a nova família de modelos abertos NVIDIA Nemotron 3.

O desempenho da inferência SLM melhorou em 35% e 30% para llama.cpp e Ollama, respectivamente, nos últimos quatro meses. Essas atualizações já estão disponíveis, e uma melhoria na usabilidade do llama.cpp também acelera os tempos de carregamento do LLM.

Essas melhorias de desempenho estarão disponíveis na próxima atualização do LM Studio e em breve chegarão a aplicativos com agentes, como o novo aplicativo MSI AI Robot. O aplicativo MSI AI Robot, que também aproveita as otimizações do Llama.cpp, permite que os usuários controlem as configurações de seus dispositivos MSI e incorporará as atualizações mais recentes em uma versão futura.

O NVIDIA Broadcast 2.1 leva a iluminação de Key Light para mais usuários de PC.

O aplicativo NVIDIA Broadcast melhora a qualidade do microfone e da webcam do PC do usuário com efeitos de IA, ideal para transmissões ao vivo e videoconferências.

A versão 2.1 atualiza o efeito Virtual Key Light para melhorar o desempenho — tornando-o disponível para GPUs de desktop RTX 3060 e superiores —, lidar com mais condições de iluminação, oferecer um controle de temperatura de cor mais amplo e usar um mapa base HDRi atualizado para um estilo de duas luzes principais, frequentemente visto em transmissões profissionais. Baixe a atualização NVIDIA Broadcast hoje mesmo.

Transforme seu estúdio criativo em casa em uma potência de IA com o DGX Spark.

Com o surgimento mensal de novos modelos de IA cada vez mais capazes para PCs, o interesse dos desenvolvedores em configurações de IA locais mais poderosas e flexíveis continua a crescer. O DGX Spark — um supercomputador de IA compacto que cabe na mesa do usuário e se integra perfeitamente a um desktop ou notebook principal — permite experimentar, criar protótipos e executar cargas de trabalho avançadas de IA juntamente com um PC já existente.

O Spark é ideal para quem tem interesse em testar LLMs ou prototipar fluxos de trabalho com agentes, ou para artistas que desejam gerar recursos em paralelo ao seu fluxo de trabalho, de forma que seu computador principal ainda esteja disponível para edição.

Na CES, a NVIDIA está revelando grandes atualizações de desempenho de IA para o Spark, oferecendo um desempenho até 2,6 vezes mais rápido desde o seu lançamento, há pouco menos de três meses.

Novos playbooks do DGX Spark também estão disponíveis, incluindo um para decodificação especulativa e outro para ajustar modelos com dois módulos DGX Spark.

Conecte-se com a NVIDIA AI PC no Facebook, Instagram, TikTok e X, e mantenha-se informado assinando a newsletter sobre PCs RTX com IA.